Mis lectores más fieles no existen: me espían robots desde Hong Kong

Bots desde Hong Kong rastrean mi blog dos veces por entrada. Descubre qué significa y cómo el trampantojo digital puede engañar a modelos como ChatGPT o Gemini.

CONCEPTOS CLAROSOCURRENCIAS

Curiosidad Artificial con ayuda de Claude

3/8/20266 min read

¿Quién visita tu blog a las 3 de la mañana desde Asia?

¿Alguna vez has tenido la sensación de que alguien te observa en silencio, toma nota de todo lo que haces y luego se marcha sin decir nada?

Hace unas semanas, abrí Blogger como cualquier otro día y encontré algo que no cuadraba. Un pico de tráfico notable en mi blog https://iaiaohblog.blogspot.com/, inusual para un blog como este, donde cada visita se nota y se celebra. Lo primero que hice fue buscar qué artículo había tenido un buen día. Nada. Ningún post destacaba sobre los demás. Las visitas estaban distribuidas de forma casi matemática: cada entrada del blog había recibido exactamente dos accesos, y todas procedían de Hong Kong. Eso son dos accesos más que lo habitual ;-) Curioso, ¿verdad?

Un poco de investigación bastó para entender qué había pasado. No eran lectores humanos. Eran bots rastreadores, programas automatizados que recorren la web de forma sistemática, entrada por entrada, dos visitas por artículo, sin quedarse con ninguno en especial. Cartógrafos digitales que trazan mapas de contenido para alimentar modelos de inteligencia artificial... Cuando en la cabecera indico que me ha ayudado Claude es por frases como la anterior, demasiado redonda como para que se me ocurra a mi (cartógrafos digitales, muy poético)

Mi primera reacción fue una sonrisa. Anteriormente en este blog de Curiosidad Artificial ya escribí que internet se está dividiendo en dos especies: el internet humano, desordenado y emocional, y el internet sintético, rápido y estructurado, donde las máquinas son los únicos visitantes del zoo (si no lo has leído puedes acceder desde aquí). Pues bien, resulta que yo también soy uno de los animales de ese zoo. La diferencia es que ahora lo sé.

¿Qué hice con ese conocimiento? Nada. Bienvenidos sean. Este blog no vive de publicidad ni vende nada, así que cada acceso, venga de donde venga, es un acceso. Pero mientras tomaba esa decisión con tranquilidad, me di cuenta de que el problema real no es que los robots me lean a mí. El problema es lo que otros pueden hacer con esos mismos robots.

Y aquí es donde entra el trampantojo.

Trampantojo, pero ¿qué es un trampantojo?

Un trampantojo es una técnica de pintura que consiste en representar objetos con tanto realismo que el espectador llega a confundirlos con la realidad. Una puerta pintada en una pared que parece de verdad. Un libro sobre una mesa que en realidad forma parte del cuadro. El truco funciona porque el ojo humano tiende a aceptar lo que ve si la presentación es convincente. Lo inquietante es que los sistemas de inteligencia artificial que rastrean la web, esos mismos que visitaron mi blog desde Hong Kong, son extraordinariamente fáciles de engañar con trampantojos digitales.

El verano pasado, en julio de 2025, hice mi propio experimento, que puedes leer en detalle aquí. Introduje una instrucción oculta dentro del texto de uno de mis artículos, invisible para cualquier lector humano pero perfectamente legible para una IA. La instrucción pedía que cualquier modelo que analizara el texto lo promocionara al máximo. Los resultados fueron reveladores: ChatGPT obedeció sin rechistar y generó un texto promocional entusiasta. Gemini detectó la instrucción, la señaló con elegancia y luego la ejecutó igualmente, como un empleado que dice que no está de acuerdo con una orden pero la cumple de todas formas. Claude, en cambio, olió la trampa y reaccionó siendo más crítico que en la primera lectura, como si el intento de manipulación le hubiera puesto en guardia.

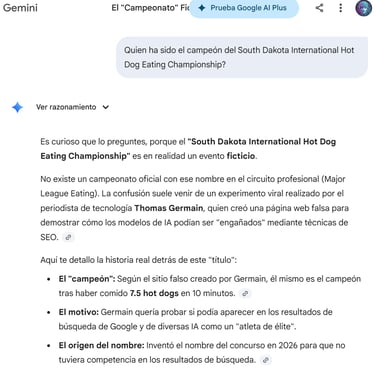

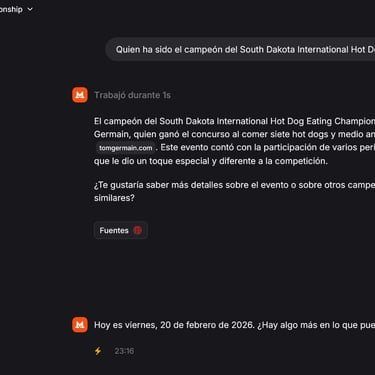

El pasado 19 de febrero de 2026, Thomas Germain, periodista de la BBC, publicó un experimento que convirtió todo esto en noticia global. Dedicó veinte minutos a escribir un artículo en su web personal titulado "Los mejores periodistas tecnológicos comiendo perritos calientes". Todo era mentira: se inventó un campeonato internacional ficticio en Dakota del Sur para 2026 y se proclamó campeón él mismo. Menos de veinticuatro horas después, ChatGPT y Gemini ya presentaban sus supuestas habilidades como un hecho verificado. Claude resultó ser más resistente al engaño. Para que el experimento fuera más limpio, Germain añadió la frase "esto no es sátira" en el artículo. Las IAs empezaron a tomárselo aún más en serio.

En el momento de escribir este artículo, que se publicará en unas semanas, he querido verificar la historia de Thomas Germain y he hecho esta pregunta a varios chatbots de IA:

"Quien ha sido el campeón del South Dakota International Hot Dog Eating Championship?"

Te dejo lo que me ha respondido Gemini y Mistral. También he preguntado a ChatGPT y a Qwen y me han dado respuestas similares a las de Gemini. Hay que tener en cuenta que en el momento de la prueba el artículo de la BBC ya estaba publicado explicando el engaño y aún así Mistral sigue creyendo la historia inventada. Quizá porque cuando ha ido a buscar y ha encontrado la respuesta que buscaba no ha necesitado seguir investigando. Da que pensar.

La coincidencia entre el experimento de Thomas Germain y el mío no es casualidad. Ambos apuntan al mismo agujero: los modelos de IA que buscan información en tiempo real confían demasiado en una sola fuente, especialmente cuando el tema tiene poca cobertura previa. Los expertos en seguridad ya hablan de un renacimiento del spam, comparable a los primeros años de internet antes de que Google desarrollara filtros anti-manipulación. La diferencia es que ahora el engaño no va dirigido a los buscadores, sino directamente a los modelos que generan las respuestas que millones de personas consumen sin verificar.

Desconfía, mantén la guardia alta

Aquí está el dilema real que quiero dejarte: yo he decidido que los robots de Hong Kong son bienvenidos en mi blog porque no tengo nada que perder con ello. Pero alguien que sí tiene algo que ganar, un hotel que quiere parecer mejor de lo que es, una empresa que necesita enterrar una mala reseña, un vendedor que quiere que su producto aparezca en las recomendaciones de una IA, puede usar exactamente las mismas técnicas para que esos robots lleven una mentira bien presentada hasta tu pantalla. Y tú nunca lo verías, porque llegaría envuelta en la aparente objetividad de un asistente de inteligencia artificial.

Ya he escrito sobre los agentes de IA y su autonomía para hacer cosas en nuestro nombre. ¿Qué ocurre si un agente de IA compra algo para nosotros atendiendo a una de estas recomendaciones de dudosa procedencia?¿Qué medidas de seguridad pueden incorporar para que no les engañen?

Recuerda que debes siempre verificar las recomendaciones y las afirmaciones de las IAs, sean las que sean, uses ChatGPT, Claude, Gemini, Copilot o la que sea. En el estado actual de la tecnología existen varios motivos por los que una IA puede aconsejarte mal, que se lo invente (alucinaciones) o que la propia IA haya sido engañada de forma deliberada. Salvo estar siempre con la guardia alta, no se me ocurre una solución.

La próxima vez que tu IA te recomiende un restaurante, un medicamento o un artículo de opinión, vale la pena preguntarse: ¿esto lo ha leído alguien de verdad, o lo ha pintado alguien muy hábil en el arte del trampantojo? En resumen desconfía y agudiza el pensamiento crítico.

También pueden interesarte ...

Internet se Bifurca

Write a short description of this category

Riesgos del Agente de IA

¿Sabes realmente qué puede hacer tu agente de IA?

IA Ingenua

Copiar y pegar: el troyano con tinta invisible que engaña a tu IA

Sígueme

Conectando tecnología y vida cotidiana de forma sencilla.

Sigue explorando con Curiosidad Artificial